最近、ローカルで動かせるAI(いわゆるローカルLLM)がかなり普及してきました。

「データが外に出ないから安全」といった話もよく見かけます。

ただ、実際に触っていると分かるのですが、

ローカルAI=完全に安全、というわけではありません。

というのも、

- どこから来たモデルなのか分からない

- 実行環境が裏で通信している可能性がある

- 改ざんされたファイルを使ってしまうリスクがある

といったポイントがあるためです。

この記事では、セキュリティに携わっている人間視点で

「ちゃんとやる場合」と「現実的な落としどころ」の両方を整理してみます。

本気で安全にするならここまでやる

まず、「絶対に安全にしたい」という前提であれば、やることはかなり明確です。

一番シンプルで強力なのは、オフライン環境で動かすことです。

インターネットに繋がっていなければ、外部送信は物理的に不可能になります。

もう少し現実的な方法としては、Windowsファイアウォールなどで

外向き通信をすべてブロックする方法があります。

必要な通信だけ許可する形にすれば、意図しない通信は基本的に防げます。

さらに踏み込むなら、Wiresharkなどでパケットキャプチャを取り、

実際に通信が発生していないかを確認することもできます。

DNSログを見て、知らないドメインへの問い合わせがないかを確認するのも有効です。

ここまでやれば、かなり高いレベルで安全性は担保できます。

ただし、正直なところ——

ここまでやる人はそこまで多くないと思います。

最近話題のAIエージェント(OpenClaw等)も結構言われてますよね、+して最小権限なども、、、 あれはあれでリスク盛りだくさんなので仕方ないと思いますが。

現実的には「モデル選び」が一番重要

実際の運用では、「完全に遮断する」よりも

「怪しいものを使わない」という判断の方が現実的です。

つまり、最低限やるべきことは

「信頼できるモデルを選ぶこと」です。

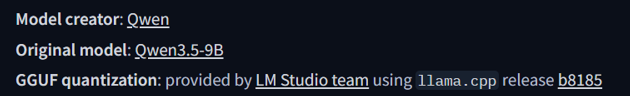

特にLM Studioなどを使っている場合、オリジナル以外

モデルのほとんどHugging Faceから来ています。

そのため、Hugging Faceの見方を知っておくことが

そのままセキュリティ対策になります。

オリジナル使えばいいんじゃない?と思いますが、

オリジナルでできなくて、派生でできることがあるんですね~、あとはPC低スペック用に用意があったりといろいろ作っている方々がいらっしゃるんですね。

Hugging Faceでまず見るべきポイント

まず一番最初に見るべきなのは次に「作成者(Author)」です。

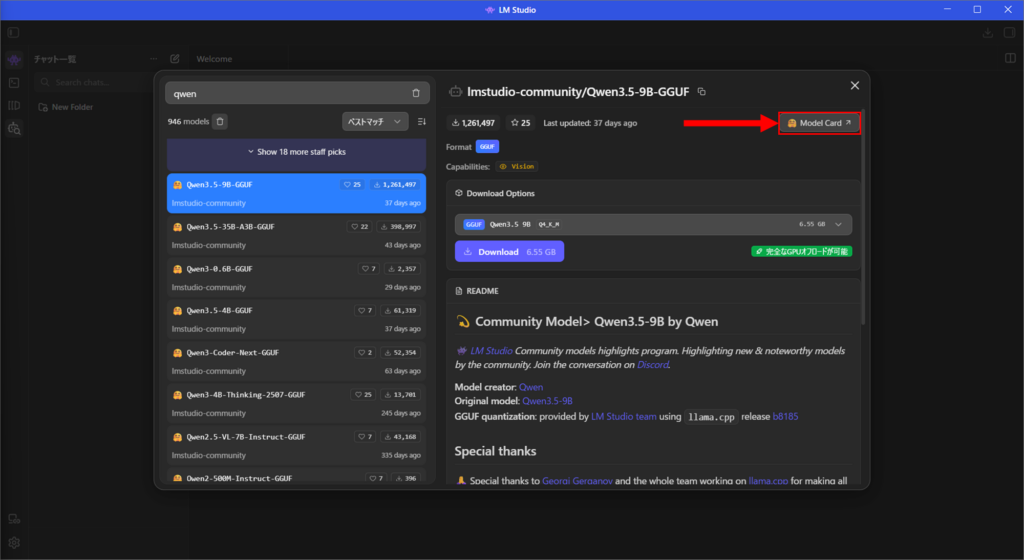

このModel Card↗をクリック

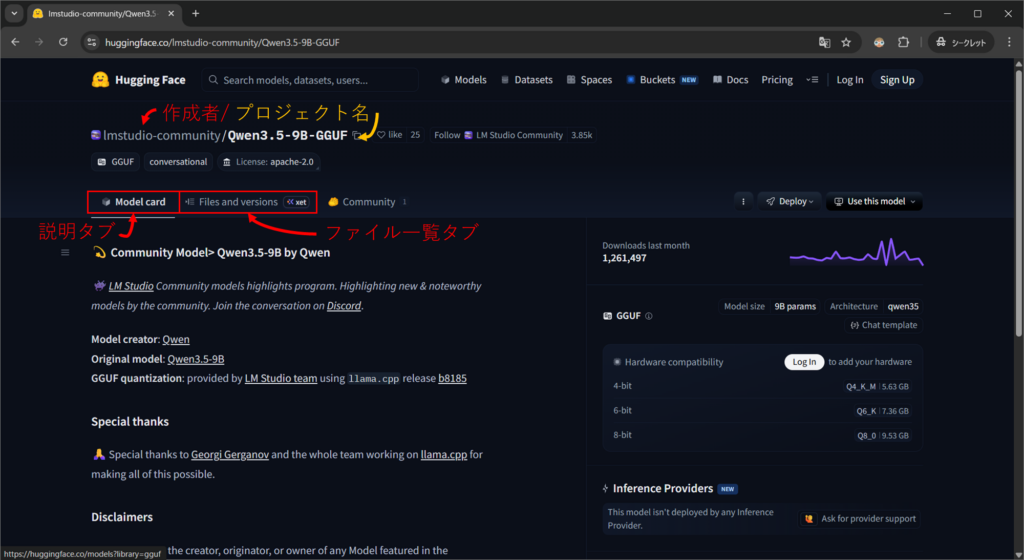

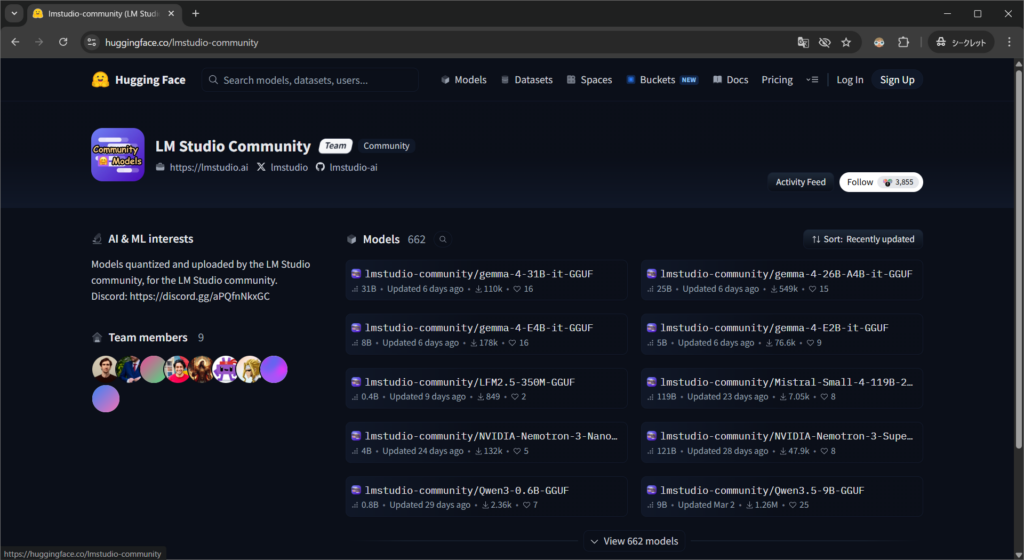

このような画面が出ます↓子の作成者をクリックすると

以下の画面が出てきます

公式や大手が出しているモデルであれば、一定の信頼性があります。

例えばLMStudioのコミュニティですね、信頼できそう、、、100パーセント信頼できるなんて言いきれない世の中~♪

一方で、無名の個人が公開しているモデルも多くあります。

すべてが危険というわけではありませんが、少なくとも「少し疑う」くらいの意識は持っておいた方がいいです。

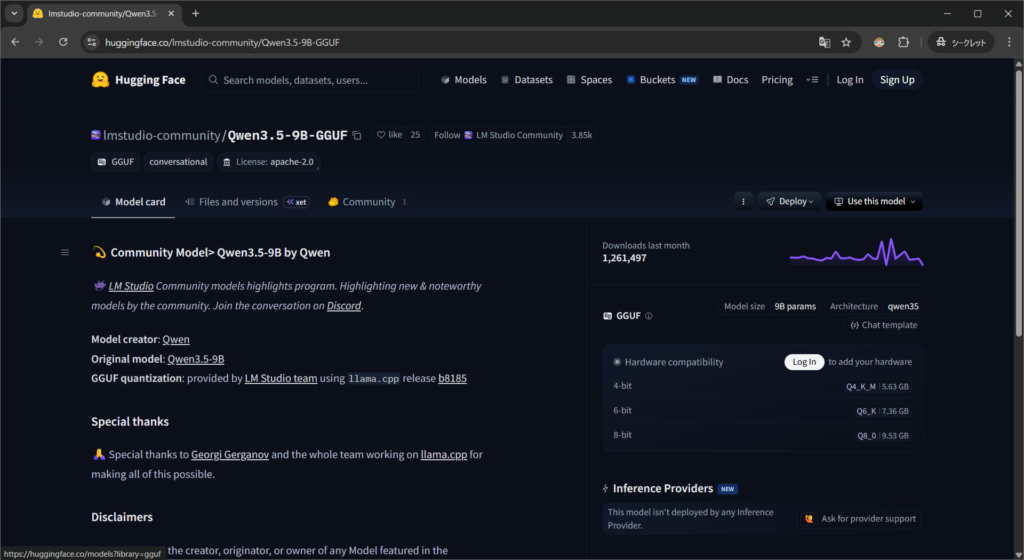

次に見るのは、そのモデルが何をベースにしているかです。

説明欄に「Based on Qwen」や「Based on Llama」といった記載があるはずです。

ここが明確に書かれているモデルは、まだ安心材料があります。

逆に、何をベースにしているのか分からないものは避けた方が無難です。

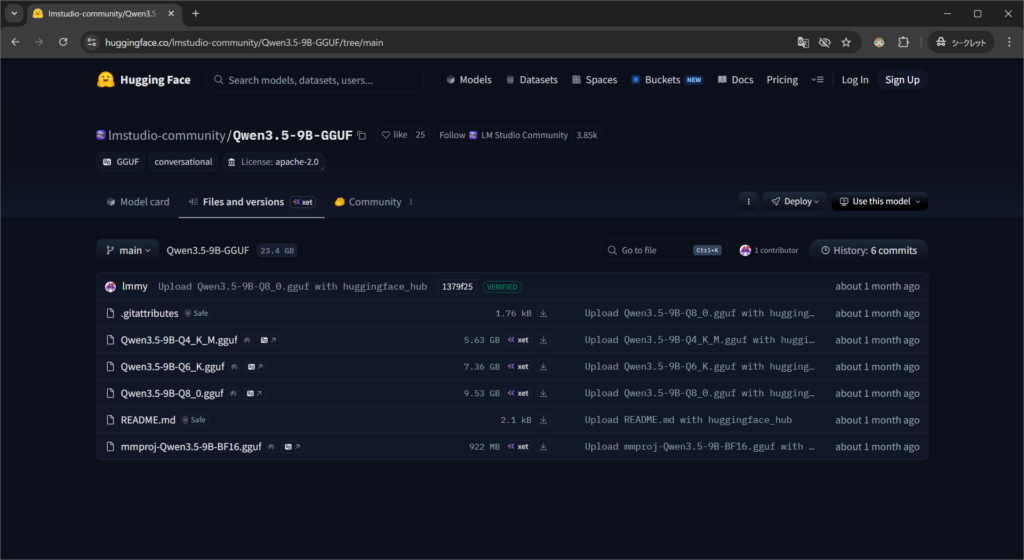

そして、セキュリティ的に一番重要なのが「Files」タブです。

ここには実際にダウンロードされるファイルが一覧で表示されています。

もし中身が .gguf や .safetensors だけであれば、

基本的には「重みデータ」なので、そのまま実行されるコードは含まれていません。

一方で、.py や .sh といったファイルが含まれている場合は注意が必要です。

これらは実行可能なコードなので、意図しない処理が含まれている可能性があります。

この一点だけでもチェックしておくと、リスクはかなり下げられます。

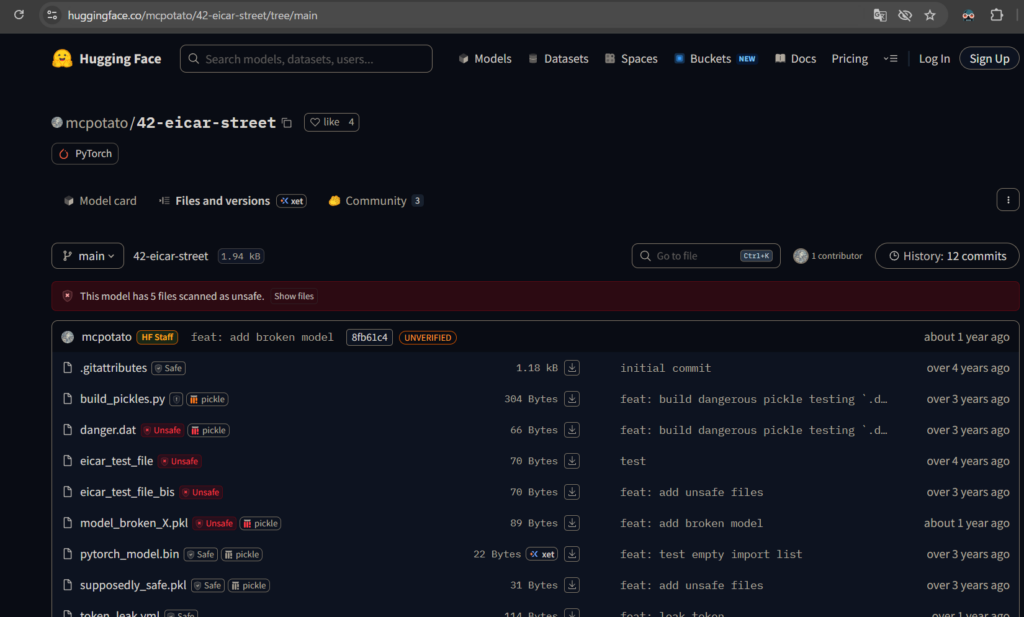

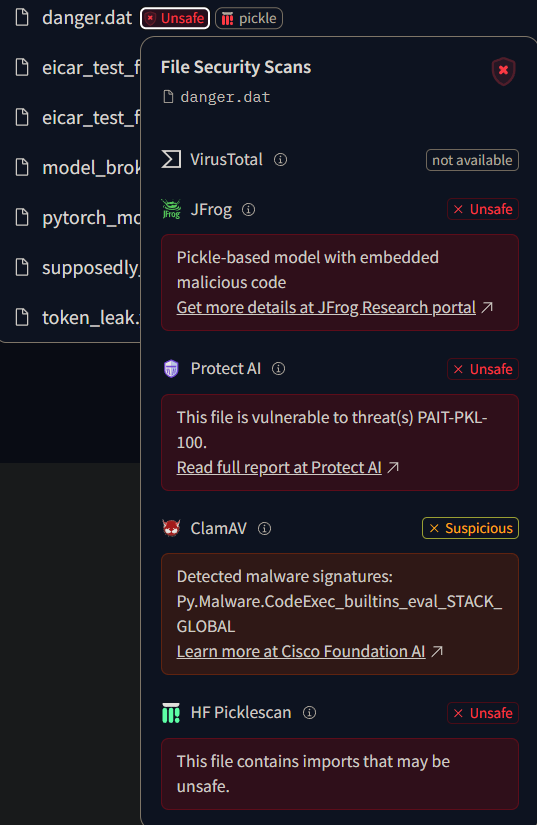

Hugging Faceのウイルススキャンについて

Hugging Face自体も、ある程度の安全対策は行っています。

アップロードされたファイルに対して、マルウェアスキャンが実施されており、

問題がなければ安全と表示されます。

ただし、これはあくまで「既知の脅威に対するチェック」です。

未知のリスクや設計上の問題までは検知できません。

そのため、「表示されているから完全に安全」と考えるのではなく、

あくまで参考情報のひとつとして見るのが良いです。

公式さんが、マルウエアを格納しているテスト環境作ってくれています危険ならUnsafeと表記されていますね

真っ赤ですね、本物はdangerなんて書いてないのでこの赤い感じ覚えておいてくださいw

ダウンロード数やいいねはどこまで見るべきか

ダウンロード数や「いいね」が多いモデルは、

それだけ多くの人が使っているという意味で安心材料にはなります。

ただし、人気がある=安全とは限りません。

単純に話題になっているだけのケースもあります。

いいねについても同様で、

不具合や挙動についてのヒントにはなりますが、

セキュリティ判断の軸としてはやや弱めです。

最低限これだけやればOK

ここまでいろいろ書きましたが、

実際には次の4つを確認するだけでも十分効果があります。

- 作成者が信頼できるか

- ベースモデルが明記されているか

- Filesに実行コード(.pyなど)が含まれていないか

- Hugging Faceの安全表示が問題ないか

このあたりを押さえておくだけで、

大きな事故はかなり防げるはずです。

まとめ

ローカルAIは確かに便利で、

クラウドに比べてデータを外に出さないという意味ではメリットがあります。

ただし、それは「自動的に安全になる」という意味ではありません。

通信を完全に遮断して厳密に管理することもできますが、

現実的にはそこまでやらないケースの方が多いと思います。

だからこそ重要なのが、

「どのモデルを使うか」という判断です。

ローカルAIは安全なツールというより、

安全に使う設計が必要なツールだと考えるのがしっくりきます。

コメント